Algoritmik Sorumluluk ve Veri Güvenliğinin Yeni Çağı

Yapay zekâ sistemleri, modern iş dünyasında sadece bir verimlilik aracı değil, aynı zamanda mülkiyet ve hak kavramlarının yeniden tanımlandığı birer “Hukuki ve Teknik Sınır Hattı” teşkil ediyor. AI Uygulamalarında Veri Koruma ve Etik Uyumluluk Rehberi (2026), Türkiye’deki teknoloji ekosisteminin bu yeni sınırlarda güvenle hareket etmesini sağlayan stratejik bir yol haritası sunuyor. Verinin ham haliyle değil, birer hak parçası olarak işlendiği bu dönemde; etik uyumluluk, şirketlerin küresel pazardaki en büyük “Güven Sertifikası” haline geliyor.

Kişisel Verileri Koruma Kurumu (KVKK) ve uluslararası AI yasalarıyla (EU AI Act) senkronize olan bu rehber, kodun ilk satırından itibaren “Tasarım Yoluyla Gizlilik” (Privacy by Design) ilkesini zorunlu kılıyor. Yapay zekânın karar alma süreçlerini şeffaf, açıklanabilir ve adil bir zemine oturtmak, artık teknik bir seçenek değil, ticari bir beka meselesidir. [Türkiye Yapay Zekâ Düzenlemeleri] HUB içeriğiyle teknik olarak bütünleşen bu döküman, kurumsal yapıların dijital dönüşümünü akademik bir disiplinle mühürlüyor.

Bu rehber; veri anonimleştirme tekniklerinden algoritmik denetim protokollerine kadar, bir AI projesinin yaşam döngüsü boyunca geçmesi gereken tüm etik ve teknik durakları detaylandırıyor. Mühendislik vakarı, sadece çalışan bir kod yazmayı değil, o kodun toplumun ahlaki ve hukuki dokusuna zarar vermemesini garanti altına almayı gerektiriyor. Gelecek, veriyi koruyan ve algoritmayı adaletle yöneten vizyoner yapıların üzerinde yükseliyor.

Teknik Anatomi: Veri Anonimleştirme ve Diferansiyel Gizlilik Stratejileri

AI modellerinin eğitim süreçlerinde kullanılan verilerin gizliliği, 2026 standartlarında “K-Anonimliği” ve “Diferansiyel Gizlilik” (Differential Privacy) yöntemleriyle korunuyor. Bu teknikler, veri seti içindeki bireyleri tanımlanabilir kılan öznitelikleri matematiksel birer “Gürültü” (Noise) katmanıyla maskeleyerek kimlik ifşasını imkansız hale getiriyor. Türkiye’deki teknoloji şirketleri, yerli veriyi işlerken bu rasyonel koruma kalkanlarını uygulayarak hem yasal sınırda kalıyor hem de analiz kabiliyetini koruyor.

Diferansiyel gizlilik, bir bireyin veri setinde olup olmamasının analitik sonucu değiştirmemesini sağlayan en ileri düzey gizlilik mimarisidir. Şirketler, bu yöntemi kullanarak hassas veri kümeleri (sağlık, finans, lokasyon) üzerinde yapay zekâ eğitimi gerçekleştirirken; verinin gizliliğini bozmadan istatistiksel trendleri yakalamayı başarıyor. Bu teknik derinlik, verinin dokunulmazlığını garanti altına alırken inovasyonun önündeki yasal engelleri rasyonel birer köprüye dönüştürüyor.

Uygulama katmanında ise “Sentetik Veri Üretimi” (Synthetic Data Generation), gerçek veriye ihtiyaç duymadan model eğitme imkanı sunarak riskleri minimize ediyor. 2026 vizyonu, şirketlerin gerçek kişisel verilere dokunmadan, o verinin matematiksel karakterini yansıtan yapay setler üzerinden dünya standartlarında algoritmalar geliştirmesini teşvik ediyor. Teknik üstünlük, verinin kendisinden ziyade, o veriyi gizleyerek işleme sanatında yatıyor.

Algoritmik Denetim ve Yanlılık (Bias) Yönetimi

Bir yapay zekâ modelinin başarısı, sadece doğruluk oranıyla değil, karar verirken sergilediği “Adalet Katsayısı” ile ölçülüyor. Eğitim setlerinde yer alan gizli yanlılıklar, algoritmanın belirli demografik gruplara karşı ayrımcı kararlar üretmesine neden olabiliyor. Bu rehber, mühendislik ekiplerinin modelleri yayına almadan önce “Yanlılık Tespit Araçları” (Bias Detection Tools) ile kapsamlı stres testlerinden geçirmesini şart koşuyor.

Algoritmik denetim süreci, bir modelin neden o kararı verdiğini rasyonel olarak açıklayabilen “XAI” (Açıklanabilir Yapay Zekâ) mimarisini merkeze alıyor. 2026 itibarıyla, yüksek riskli AI uygulamalarında kullanılan “Kara Kutu” (Black Box) modellerinin şeffaflaştırılması, kurumsal sorumluluğun birincil parçasıdır. Şirketler, algoritmik bir hatanın neden olduğu zarardan sorumlu tutuldukları bu dönemde, karar mekanizmalarını dijital birer “Log Defteri” (Audit Trail) ile kayıt altına alıyor.

Etik denetim, sadece yazılım aşamasında değil, ürünün tüm yaşam döngüsü boyunca dinamik bir şekilde sürdürülüyor. Modelin zamanla veriye bağlı olarak sapma (Model Drift) gösterip göstermediği, otonom izleme sistemleri tarafından 7/24 takip ediliyor. Türkiye’nin vizyoner girişimleri, algoritmayı bir kez üretip bırakmak yerine, onun etik gelişimini sürekli denetleyen “Dijital Mürebbiye” sistemlerini inşa ediyor.

Mühendis Defteri: Diferansiyel Gizlilik ve Veri Faydası Dengesi

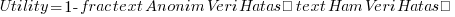

Veri anonimleştirme süreçlerinde gizlilik seviyesi artırıldığında, verinin analitik faydası ( ) azalma eğilimi gösterir. Bu dengeyi optimize etmek için kullanılan temel mühendislik metriği şudur:

) azalma eğilimi gösterir. Bu dengeyi optimize etmek için kullanılan temel mühendislik metriği şudur:

Formül:

Ayrıca,  -gizlilik kuralı uyarınca, veri kümesindeki tek bir öğenin değişiminin çıktı üzerindeki etkisi şu eşitsizlikle sınırlanır:

-gizlilik kuralı uyarınca, veri kümesindeki tek bir öğenin değişiminin çıktı üzerindeki etkisi şu eşitsizlikle sınırlanır:

![Pr[K(D_1) in S] le e^{epsilon} cdot Pr[K(D_2) in S] Pr[K(D_1) in S] le e^{epsilon} cdot Pr[K(D_2) in S]](https://yerliarac.com/wp-content/plugins/wpmathpub/phpmathpublisher/img/math_981.5_3dfe3375ad731dd9ca128f80a9868ef0.png)

Teknik Analiz: 2026 Türkiye uyumluluk kriterleri, kurumsal uygulamalarda  değerinin belirlenen limitlerin altında tutulmasını ve

değerinin belirlenen limitlerin altında tutulmasını ve  eşiğinin korunmasını zorunlu kılmaktadır. Bu hesaplama, verinin hem gizli kalmasını hem de mühendislik açısından anlamlı sonuçlar üretmesini matematiksel olarak garanti eder.

eşiğinin korunmasını zorunlu kılmaktadır. Bu hesaplama, verinin hem gizli kalmasını hem de mühendislik açısından anlamlı sonuçlar üretmesini matematiksel olarak garanti eder.

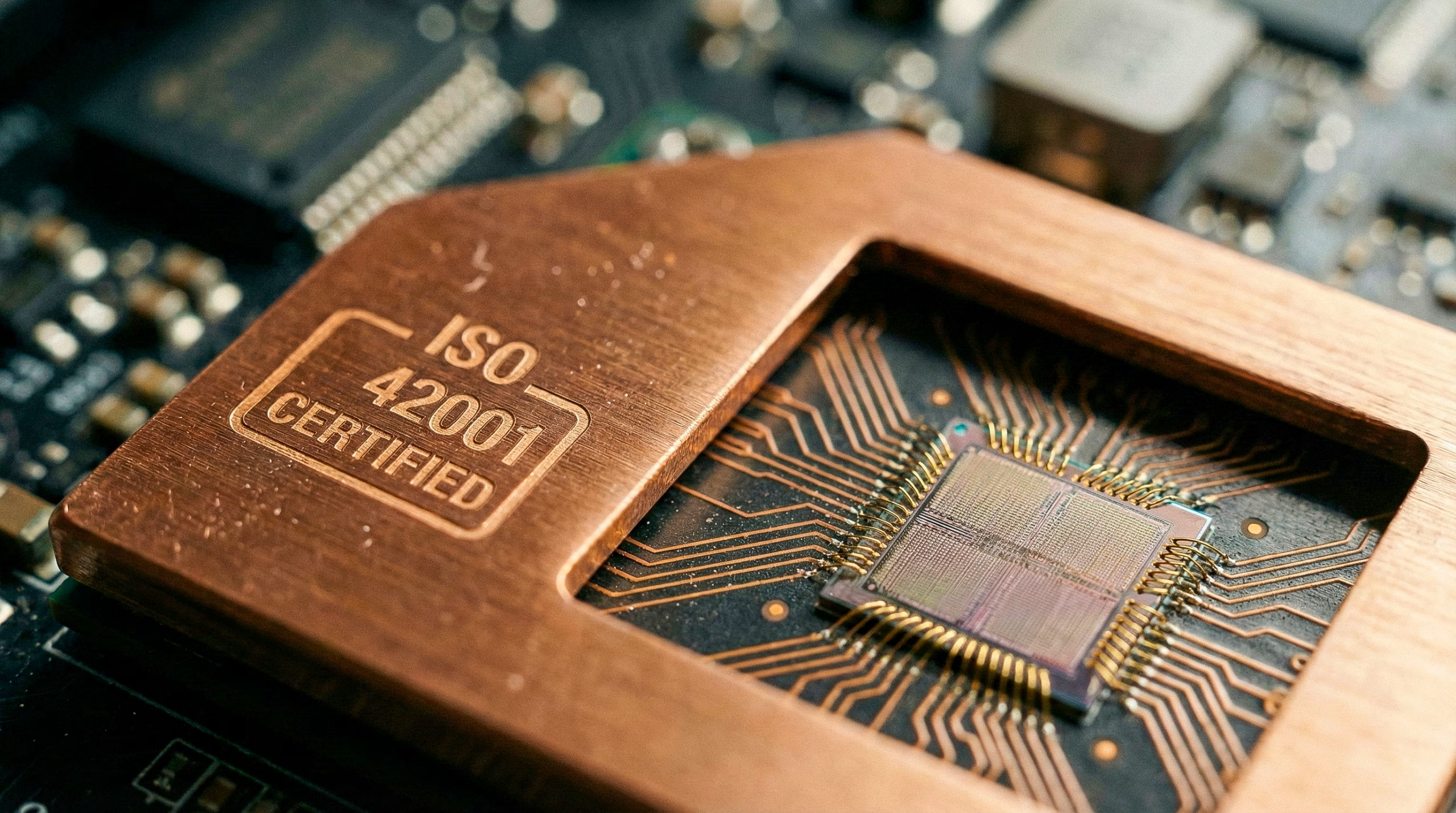

X-Factor: ISO 42001 ve KVKK 2026 Uyum Standartları

Yapay zekâ yönetimi için küresel bir standart olan ISO/IEC 42001, 2026 yılı itibarıyla Türkiye’deki teknoloji şirketleri için bir “Güven Pasaportu” niteliği kazanıyor. Bu sertifikasyona sahip olmayan AI sistemlerinin kritik altyapılarda görev alması veya kamu ihalelerinde yer alması stratejik bir engel olarak tanımlanıyor. Sertifikasyon, şirketin veriyi nasıl yönettiğinden ziyade, algoritmik riskleri nasıl kontrol altında tuttuğunu tescilliyor.

Mevzuat tarafında ise KVKK’nın yapay zekâya özel güncel rehberleri, “Açık Rıza” mekanizmalarının algoritmik eğitimlerdeki rolünü netleştiriyor. 2026 projeksiyonunda, anonimleştirilmemiş verilerle eğitilen modellerin “Veri İhlali” kapsamında değerlendirilmesi, şirketler için ciddi finansal riskler oluşturuyor. Bu süreçte yerli “Güvenli Bulut” (Sovereign Cloud) altyapılarını kullanmak, verinin ulusal sınırları terk etmeden işlenmesini sağlayan birincil “X-Factor” olarak öne çıkıyor.

AB Yeşil Mutabakatı ile gelen “Algoritmik Karbon Ayak İzi” düzenlemeleri ise işin sürdürülebilirlik boyutunu tamamlıyor. Çok büyük modellerin eğitilmesi sırasında harcanan enerjinin raporlanması ve optimize edilmesi, ihracat odaklı AI şirketleri için bir tercih değil, zorunluluktur. Türkiye’nin 2026 vizyonu, etik olanın aynı zamanda çevreci ve yasal olmasını gerektiren bütünleşik bir disiplin seviyesini hedefliyor.

Yatırım Fırsatı (3 Katmanlı)

- Mikro Girişimci: Şirketler için AI etik stres testleri yapan butik danışmanlık ofisleri ve veri etiketleme süreçlerinde yanlılık ayıklayan yazılım araçları geliştirme.

- KOBİ: Mevcut AI sistemlerini ISO 42001 standartlarına uyumlu hale getiren “Sistem Entegratörlüğü” ve sentetik veri üretim platformları sağlayıcılığı.

- Holding: Ulusal düzeyde AI Denetim ve Sertifikasyon Merkezleri yatırımı, büyük ölçekli Diferansiyel Gizlilik altyapıları ve siber-fiziksel güvenlik sigortacılığı.

Sıkça Sorulan Sorular (SSS)

AI projelerinde etik uyumluluk zorunlu mu?

2026 itibarıyla kamu ihaleleri, kritik altyapı projeleri ve finans-sağlık gibi hassas sektörlerde etik uyumluluk ve sertifikasyon yasal birer zorunluluk haline gelmiştir.

Veri anonimleştirme model başarısını düşürür mü?

Doğru tekniklerle (Diferansiyel Gizlilik optimizasyonu) yapıldığında, modelin genel başarısındaki kayıp %5-10 seviyesinde kalırken, yasal riskler %100 oranında minimize edilir.

Yerli AI şirketleri hangi sertifikaları almalı?

Öncelikle ISO 27001 (Veri Güvenliği) ve ISO 42001 (Yapay Zekâ Yönetimi) sertifikaları, küresel pazara açılmak ve yerli mevzuata uyum sağlamak için temel şarttır.

Executive Summary: Technical Report

The Architecture of Trust: AI Data Protection and Ethical Compliance Roadmap 2026

The “AI Data Protection and Ethical Compliance Guide 2026” establishes the definitive engineering and legal framework for the deployment of artificial intelligence within the Turkish corporate landscape. Moving beyond basic implementation, this technical guide emphasizes the transition to “Privacy by Design,” mandating the use of Differential Privacy and K-Anonymity protocols to safeguard individual data rights while maintaining analytical utility. The report utilizes the  formula to benchmark model performance, ensuring that indigenous AI solutions meet the rigorous standards of the [Turkey AI Regulations] HUB. By quantifying the trade-offs between privacy levels and model accuracy, Turkish enterprises can achieve a balance that secures both national digital assets and international competitive advantage.

formula to benchmark model performance, ensuring that indigenous AI solutions meet the rigorous standards of the [Turkey AI Regulations] HUB. By quantifying the trade-offs between privacy levels and model accuracy, Turkish enterprises can achieve a balance that secures both national digital assets and international competitive advantage.

A critical focus of this roadmap is the mitigation of algorithmic bias and the enhancement of transparency through “Explainable AI” (XAI) architectures. The guide outlines the necessity of maintaining comprehensive Audit Trails and conducting regular bias detection tests to ensure mathematical fairness in automated decision-making. These protocols are no longer optional but essential components of corporate liability management in an era where algorithms directly impact sectors such as finance, healthcare, and national security. The report further identifies the integration of 2026 KVKK directives and the ISO 42001 management standard as the primary “X-Factor” for market penetration and sustainable innovation.

From an investment perspective, the 2026 vision identifies a multi-tiered growth opportunity: micro-enterprises providing niche ethical auditing services, SMEs acting as system integrators for synthetic data platforms, and major holdings establishing large-scale Sovereign Cloud and AI Certification centers. By adopting these high-fidelity compliance standards, Turkey is positioning its DeepTech ecosystem as a regional hub for “Trusted AI.” The synergy between localized hardware engineering and ethically-sound control systems will define the nation’s industrial sovereignty and its edge in the global digital economy for the next decade.